糟糕的机器人音乐时代即将来临。Adobe正在开发一种新的人工智能工具,该工具可以让任何人成为音乐制作人——即使他们没有乐器或编辑经验。

该公司公布了名为“Project Music GenAI Control”的工具原型。在此工具的帮助下,用户可以在生成式人工智能模型中输入简单的文本提示来生成和编辑音乐。Adobe解释说,这些文本提示可以为“强大的摇滚”、“快乐的舞蹈”或“悲伤的爵士乐”这样的描述。

然后,Project Music GenAI Control将根据用户的提示创建初始曲调,用户也可以使用文本进行编辑。Adobe表示,用户可以编辑生成的音乐强度,延长音乐剪辑的长度,创建可重复的循环等。

Adobe高级研究科学家、该技术的创造者之一尼古拉斯·布莱恩(Nicholas Bryan)说,这项新工具的目标受众包括播客、广播公司和“任何需要情绪、音调和长度恰到好处的音频的人”。

布莱恩在Adobe 博客的一篇文章中说:“这些新工具令人兴奋的一点是,它们不仅仅是用来生成音频的,它们就像 Photoshop的水平 一样,赋予创作者深度控制权,让他们可以塑造、调整和编辑音频。“这就像像素级控制图像一样。”

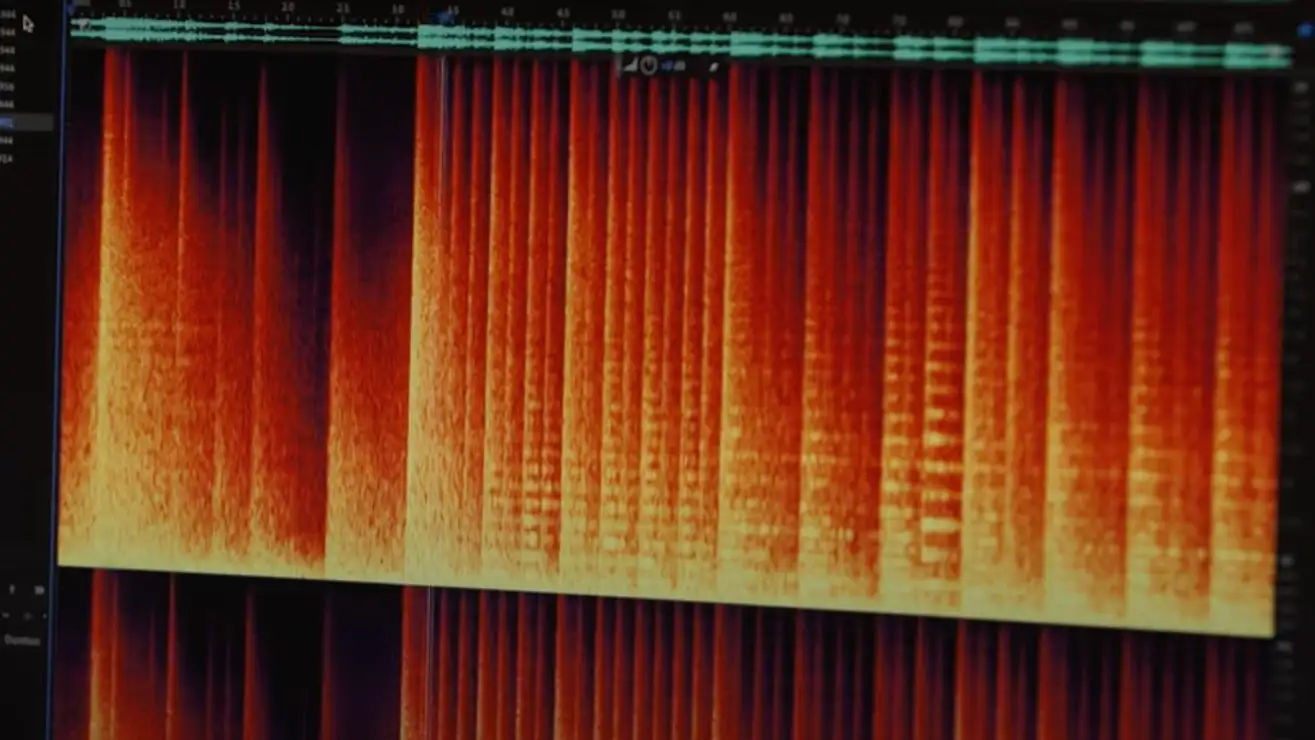

Adobe上传了一个视频,展示了Project Music GenAI Control是如何工作的,该工具可以非常容易地生成音乐,这令人害怕。它似乎工作得太快了。虽然它产生的音乐不会赢得任何格莱美奖,但那些音乐就像YouTube视频、TikToks或Twitch直播的背景音乐。

这可不是什么好事。人工智能已经在写作和表演等职业中产生了反响,迫使人们表明立场,防止他们丢失工作。该公司YouTube视频上的评论呼应了这些担忧,抨击该公司发明了“机器人为机器人创作音乐”和“优秀企业的难堪”。

一位用户写道,“感谢Adobe试图找到更多的方法让企业把创作人员挤出工作岗位。还有,你们从哪些艺术家那里偷了用来训练人工智能的材料?”

当Gizmodo要求Adobe予以置评时,Adobe并没有透露其用于为Project Music GenAI Control训练其人工智能模型的相关音乐信息。然而,它确实指出,对于其人工智能图像生成器Firefly,Adobe只在公开许可授权內容和版权过期的公共领域內容上训练其模型。

Adobe发言人Anais Gragueb在一封电子邮件中告诉Gizmodo:“Project Music GenAI control是Adobe Research开发的一项非常早期的技术,虽然我们还没有透露该模型的细节,但我们可以分享的是:Adobe一直采取积极主动的方法,确保我们以负责任的方式进行创新。”

音乐是艺术,其本质是通人的。因此,当涉及到像Adobe发明的这样的新工具时,我们必须小心——否则,在未来,音乐听起来就会像机器生成的一样空洞。

(机器翻译,轻度译后编辑,仅供参考。)

编辑:李旭媛